La computación surge como respuesta a un problema concreto: la creciente dificultad para procesar grandes volúmenes de información con precisión y rapidez. A medida que las sociedades se volvieron más complejas, también lo hicieron sus sistemas administrativos, financieros, militares y científicos. Los cálculos necesarios para gestionar censos, impuestos, estadísticas o investigaciones técnicas, comenzaron a superar la capacidad humana en términos de tiempo y margen de error. Pocas personas calificadas para tareas complejas, con una tasa muy alta de errores.

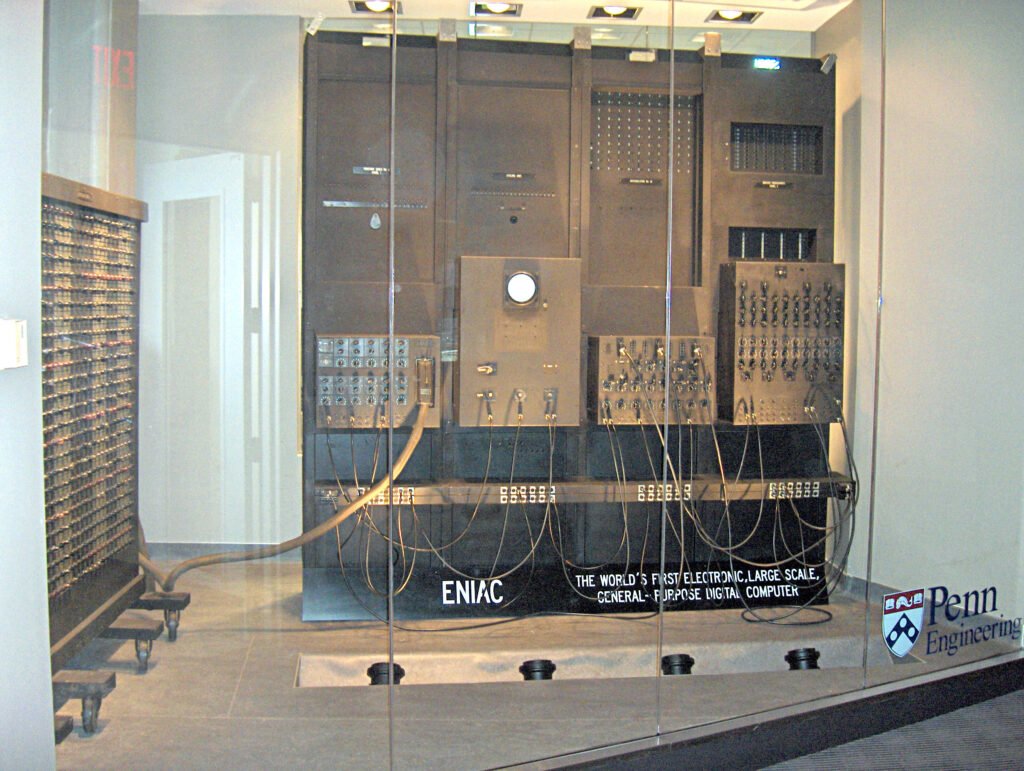

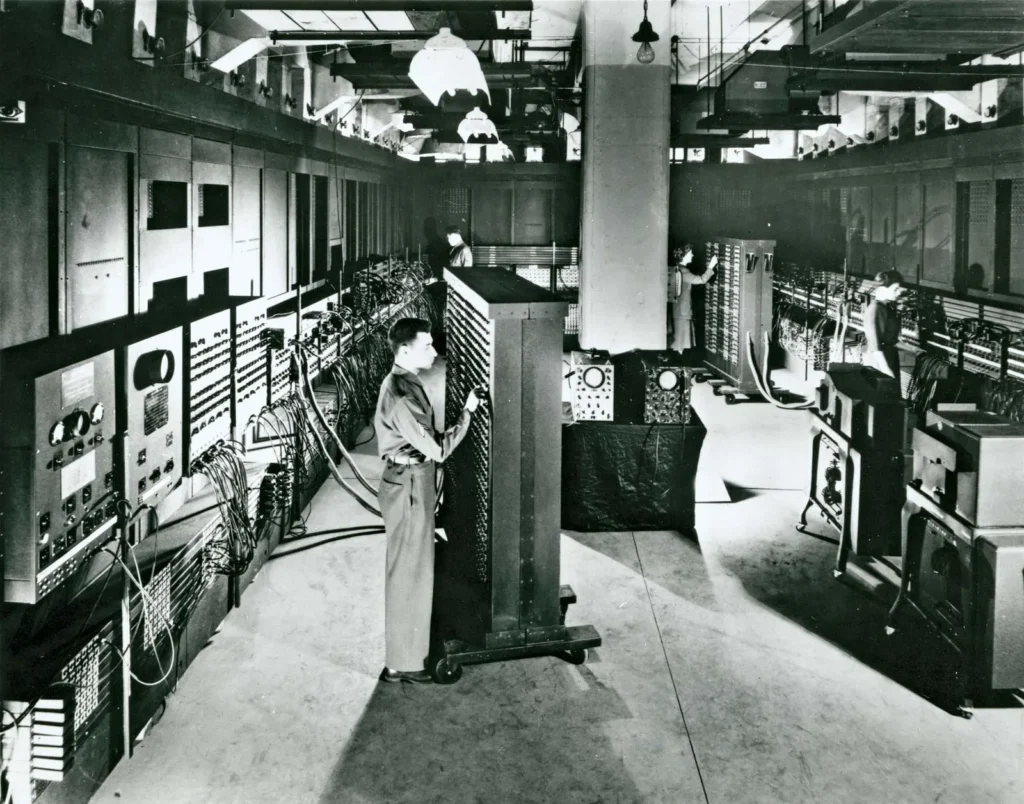

En ese contexto aparecieron las primeras máquinas de cálculo. Eran dispositivos mecánicos diseñados para ejecutar operaciones matemáticas de forma automática siguiendo una secuencia de instrucciones. Su propósito era aumentar la eficiencia y reducir errores en tareas repetitivas. Con el tiempo, la idea de automatizar operaciones se amplió hacia el procesamiento estructurado de información, lo que dio origen a la computación moderna.

El avance tecnológico permitió que estas máquinas evolucionaran desde sistemas mecánicos a dispositivos electrónicos capaces de ejecutar millones de operaciones por segundo. A medida que su capacidad creció, también lo hizo su aplicación en distintas áreas: contabilidad, investigación científica, defensa, telecomunicaciones y posteriormente en el ámbito doméstico y empresarial.

La informática, como disciplina, se consolidó en torno a la idea de organizar, almacenar y procesar información de manera sistemática. Este proceso implicó trasladar tareas que antes realizaban personas hacia sistemas automatizados que operan bajo reglas definidas. Cada vez que una organización implementa un sistema informático, está confiando en que ese sistema ejecutará procesos críticos de forma consistente y segura.

Con el paso del tiempo, la información comenzó a adquirir un valor estratégico. Los datos financieros, los registros personales, la propiedad intelectual y los sistemas de operación empresarial pasaron a depender de infraestructuras digitales. Esta dependencia marcó un punto de inflexión. Cuando la información se vuelve central para la vida cotidiana y la actividad económica, también se convierte en un activo que puede ser vulnerado, manipulado o robado.

Comprender el origen de la computación permite entender un aspecto fundamental del escenario actual: la tecnología siempre ha estado orientada a optimizar procesos, pero su evolución la transformó en la base sobre la cual funcionan las organizaciones y gran parte de nuestra vida diaria.

El concepto de seguridad digital surge precisamente en ese punto, cuando la información deja de ser un simple registro y se convierte en un activo crítico. Cuando los sistemas tecnológicos pasan a sostener operaciones financieras, militares, comunicaciones, historiales médicos, contratos, identidades y decisiones estratégicas de Estado, el riesgo adquiere una dimensión completamente distinta. Ya no se trata sólo de que un computador o una aplicación fallen. Se trata de que alguien pueda acceder a datos personales, suplantar una identidad, vaciar cuentas bancarias, extorsionar a una organización o paralizar por completo la operación de una empresa.

La interrupción de un sistema puede significar pérdidas económicas significativas, daño reputacional difícil de revertir o la exposición de información sensible que afecta directamente a personas reales. En otros escenarios, una vulnerabilidad tecnológica puede incluso escalar hacia tensiones políticas o conflictos de alcance internacional de dimensiones catastróficas.

Proteger la información y garantizar la continuidad de los sistemas deja de ser una cuestión técnica. Se convierte en una necesidad estratégica porque detrás de cada sistema hay personas cuya información, trabajo y recursos podrían llegar a verse comprometidos.

La mayoría de las empresas no sabe si es segura… hasta que ya es tarde.

Revisamos en 30 minutos si tu empresa es un blanco fácil y entregamos un diagnóstico claro, sin tecnicismos ni compromisos.